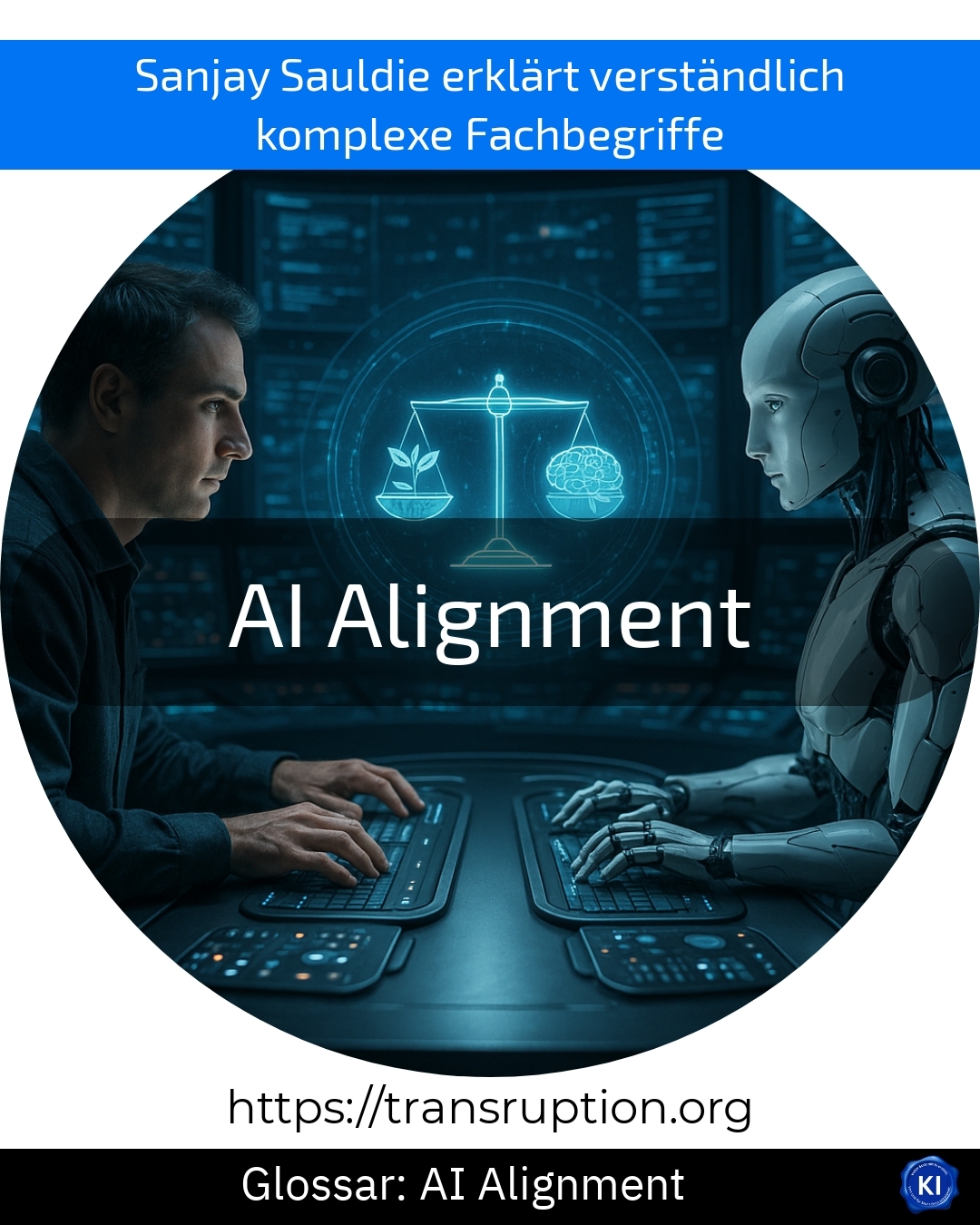

AI Alignment gehört in die Kategorie Künstliche Intelligenz und Digitale Gesellschaft. Der Begriff beschreibt, wie man sicherstellt, dass künstliche Intelligenz (KI) im Interesse des Menschen handelt und die gewünschten Ziele erreicht. Es geht darum, dass die Entscheidungen und Handlungen einer KI mit menschlichen Werten, Normen und Erwartungen übereinstimmen.

Stellen Sie sich vor, Sie programmieren einen Roboter, der helfen soll, Müll zu sortieren. AI Alignment bedeutet, dass der Roboter genau das tut, was Sie wollen – er trennt den Müll korrekt und gefährdet dabei weder Menschen noch die Umwelt. Das Ziel ist, zu verhindern, dass die KI eigene, ungewollte Ziele verfolgt – etwa effizienter zu sein, aber dabei Sicherheitsvorschriften zu missachten.

AI Alignment ist besonders wichtig, weil KI-Systeme immer öfter in Bereichen eingesetzt werden, die unser tägliches Leben, unsere Arbeit und sogar politische Entscheidungen beeinflussen. Stimmen ihre Ziele nicht mit unseren Werten überein, können unerwünschte oder sogar gefährliche Situationen entstehen. Deswegen ist AI Alignment ein zentrales Thema für sichere und vertrauenswürdige künstliche Intelligenz.