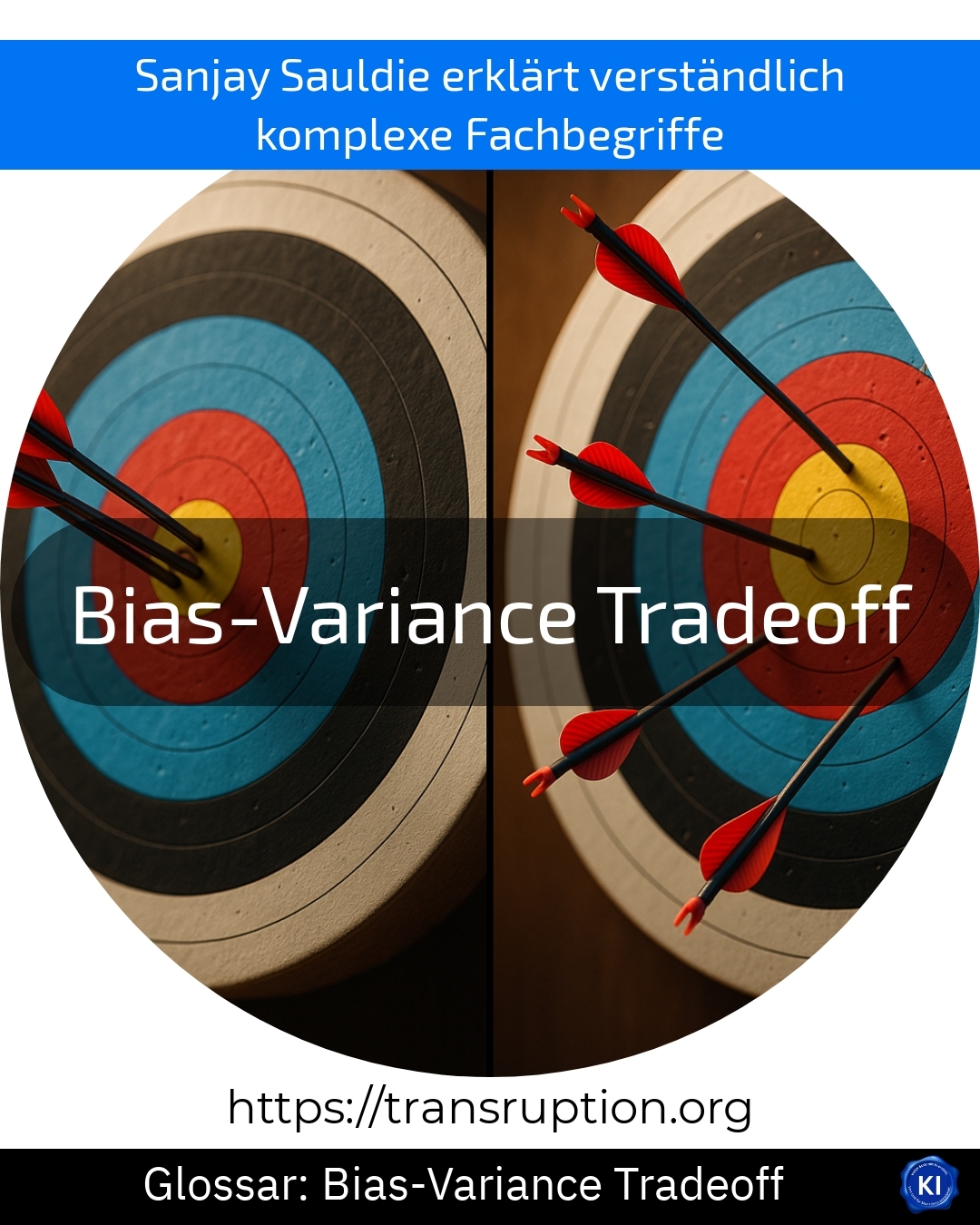

The term bias-variance trade-off originates from the fields of artificial intelligence, big data and digital transformation. It describes the balance between two important factors that play a role in the training of algorithms: Bias and Variance.

In concrete terms, this means that if a computer program, for example an image recognition system, is too simplified (high bias), it may recognise apples as tomatoes because it does not pay enough attention to details. If, on the other hand, the program is too complicated and "learns" all the details from the training data by heart (high variance), it will have difficulty recognising new images because it does not generalise enough.

The bias-variance trade-off is like finding the right balance when riding a bike: If you focus too much on one side, you tip over. A practical example: an online shop wants to predict which products a customer will buy. A model that is too simple (high bias) often misses the mark. A model that is too complex (high variance) recognises patterns in previous purchasing behaviour, but is unable to deal with new trends.

The challenge with the bias-variance trade-off is therefore to adapt algorithms so that they function robustly and reliably, even when they encounter new data.